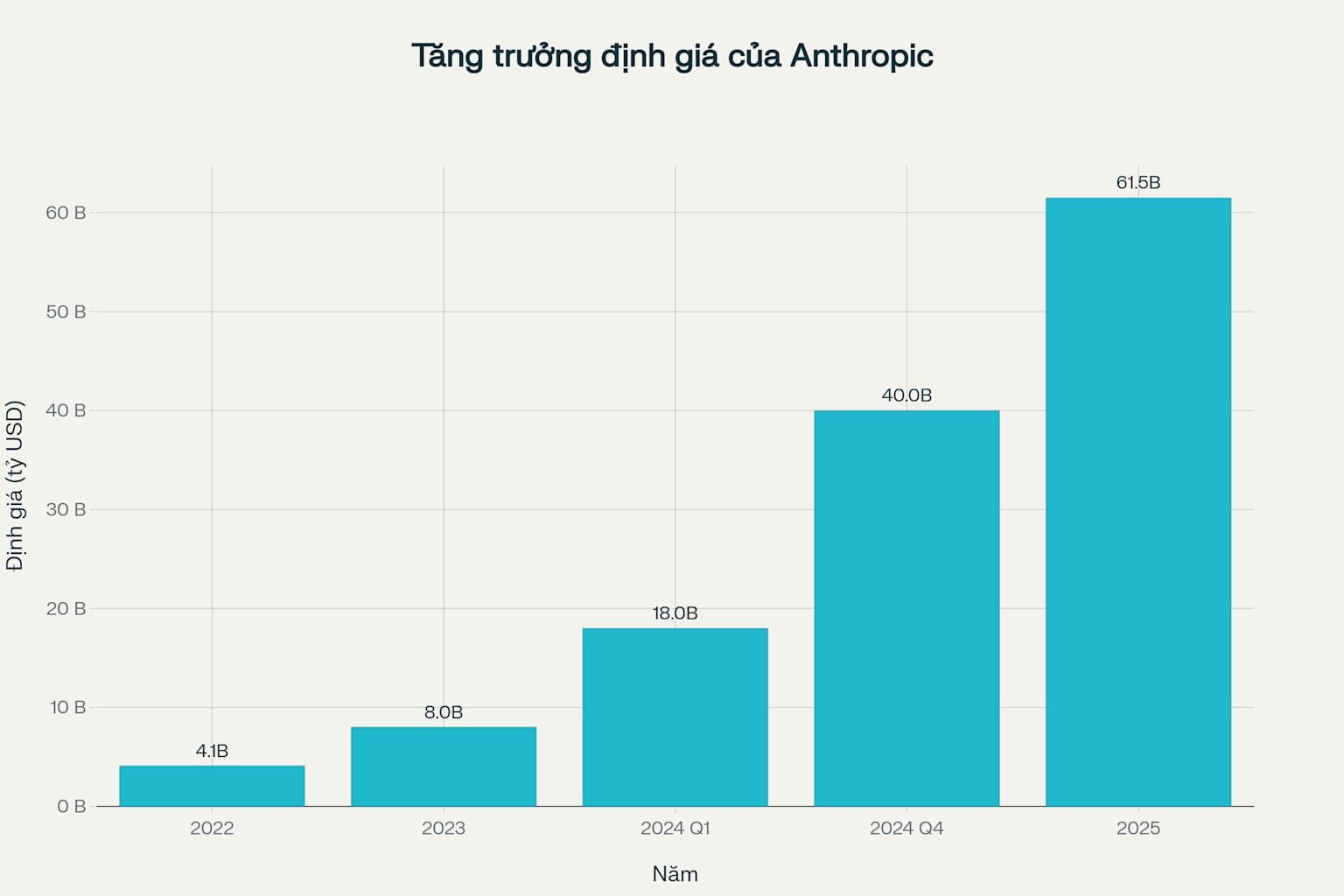

Trong bối cảnh cuộc đua phát triển trí tuệ nhân tạo ngày càng gay gắt, Anthropic đã nổi lên như một tiếng nói quan trọng trong việc đề xuất một cách tiếp cận có trách nhiệm và tập trung vào an toàn. Được thành lập năm 2021 bởi anh chị em Dario và Daniela Amodei cùng với một nhóm các nhà nghiên cứu cựu OpenAI, công ty này đã trở thành một trong những thế lực đáng gờm nhất trong lĩnh vực AI an toàn. Với định giá lên tới 61.5 tỷ USD vào năm 2025 và sản phẩm Claude AI được đánh giá cao, Anthropic đang chứng minh rằng việc ưu tiên đạo đức và an toàn không chỉ là lý tưởng mà còn có thể là một chiến lược kinh doanh bền vững.

Bối Cảnh Lịch Sử: Cuộc Ly Khai Khỏi OpenAI

Căn Nguyên Của Sự Chia Tách

Cuộc ly khai của nhóm Anthropic khỏi OpenAI có nguồn gốc từ những bất đồng sâu sắc về định hướng phát triển AI. Dario Amodei, người từng giữ vị trí Phó Chủ tịch Nghiên cứu tại OpenAI và đóng góp quan trọng vào việc phát triển GPT-2 và GPT-3, đã rời khỏi công ty vào cuối năm 2020 cùng với sáu đồng nghiệp khác. Quyết định này được thúc đẩy bởi lo ngại về việc OpenAI chuyển từ tổ chức phi lợi nhuận sang mô hình "capped-profit" và nhận đầu tư 1 tỷ USD từ Microsoft vào năm 2019.

Trong thông báo chính thức về việc Dario Amodei rời OpenAI, CEO Sam Altman đã nhấn mạnh rằng cả hai bên vẫn chia sẻ mục tiêu về "artificial general intelligence an toàn để mang lại lợi ích cho nhân loại". Tuy nhiên, những khác biệt về cách tiếp cận đã trở nên không thể hàn gắn, đặc biệt khi Anthropic tin rằng việc thương mại hóa quá nhanh có thể làm suy giảm trọng tâm nghiên cứu về an toàn AI.

Triết Lý Sáng Lập

Anthropic được thành lập với sứ mệnh rõ ràng là xây dựng các hệ thống AI "đáng tin cậy, có thể diễn giải và có thể điều khiển". Khác với nhiều công ty AI khác tập trung vào việc mở rộng khả năng một cách nhanh chóng, Anthropic từ đầu đã đặt an toàn và đạo đức lên hàng đầu. Công ty được thành lập dưới hình thức public benefit corporation, có nghĩa vụ pháp lý phải ưu tiên tác động xã hội tích cực hơn là lợi nhuận.

Cách Tiếp Cận An Toàn AI Độc Đáo

Constitutional AI - Nền Tảng Đạo Đức

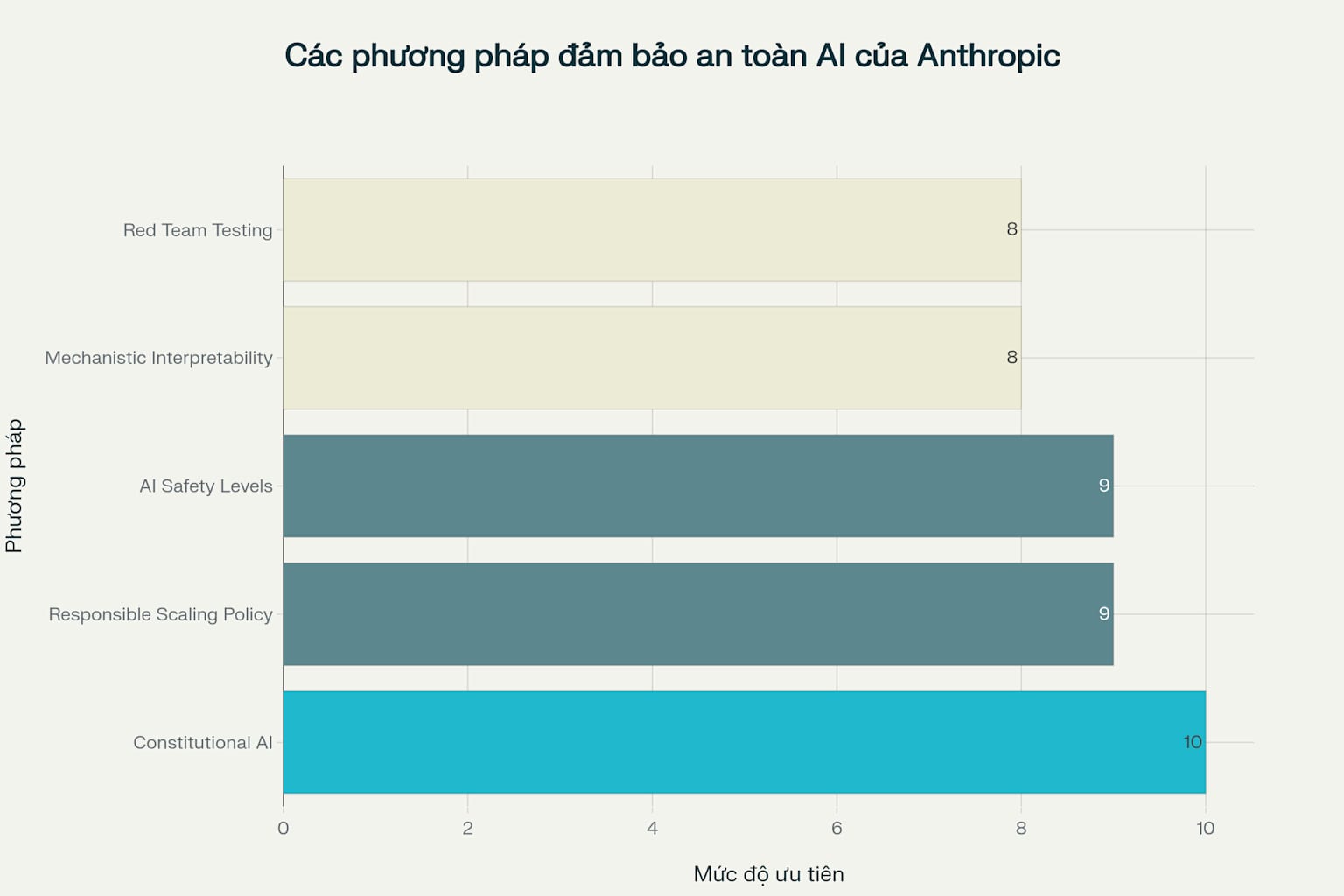

Một trong những đóng góp quan trọng nhất của Anthropic cho lĩnh vực AI là phát triển phương pháp Constitutional AI. Thay vì dựa vào phản hồi của con người trong quá trình huấn luyện, Constitutional AI cho phép các mô hình tự đánh giá và cải thiện hành vi của mình dựa trên một "hiến pháp" - tập hợp các nguyên tắc đạo đức được định nghĩa rõ ràng. Cách tiếp cận này được lấy cảm hứng từ nhiều nguồn khác nhau, bao gồm Điều khoản Dịch vụ của Apple, Tuyên ngôn Nhân quyền của Liên Hợp Quốc, và các đề xuất từ các phòng thí nghiệm nghiên cứu khác.

Responsible Scaling Policy (RSP)

Anthropic đã phát triển một khung chính sách gọi là Responsible Scaling Policy, được thiết kế để quản lý rủi ro khi các mô hình AI trở nên mạnh mẽ hơn. Chính sách này định nghĩa các AI Safety Levels (ASL), được mô phỏng theo tiêu chuẩn biosafety level (BSL) của chính phủ Mỹ dành cho việc xử lý vật liệu sinh học nguy hiểm. Hệ thống ASL yêu cầu các tiêu chuẩn an toàn, bảo mật và vận hành phù hợp với tiềm năng rủi ro thảm họa của mô hình, với các cấp độ ASL cao hơn đòi hỏi những chứng minh an toàn ngày càng nghiêm ngặt.

Mechanistic Interpretability và Nghiên Cứu An Toàn

Anthropic đầu tư mạnh mẽ vào nghiên cứu mechanistic interpretability - việc hiểu rõ cơ chế hoạt động bên trong của các mô hình neural network. Mục tiêu là "reverse engineering" các cơ chế tính toán và biểu diễn được học bởi mạng neural thành các thuật toán và khái niệm mà con người có thể hiểu được. Điều này rất quan trọng để đảm bảo rằng các hệ thống AI hoạt động theo cách dự đoán được và phù hợp với giá trị con người.

Sự Phát Triển Ấn Tượng Về Tài Chính

Lịch Sử Gọi Vốn Đáng Kinh Ngạc

Từ khi thành lập, Anthropic đã chứng kiến sự tăng trưởng tài chính đáng kinh ngạc. Công ty bắt đầu với vòng Series A 580 triệu USD năm 2022, sau đó nhận được đầu tư từ các gã khổng lồ công nghệ như Google và Amazon. Đặc biệt, Amazon đã cam kết đầu tư tổng cộng 8 tỷ USD vào Anthropic, trong khi Google cũng đầu tư hơn 3 tỷ USD. Vào tháng 3 năm 2025, công ty đã hoàn thành vòng Series E với mức định giá 61.5 tỷ USD, khẳng định vị thế là một trong những startup AI có giá trị nhất thế giới.

Tăng Trưởng Doanh Thu Mạnh Mẽ

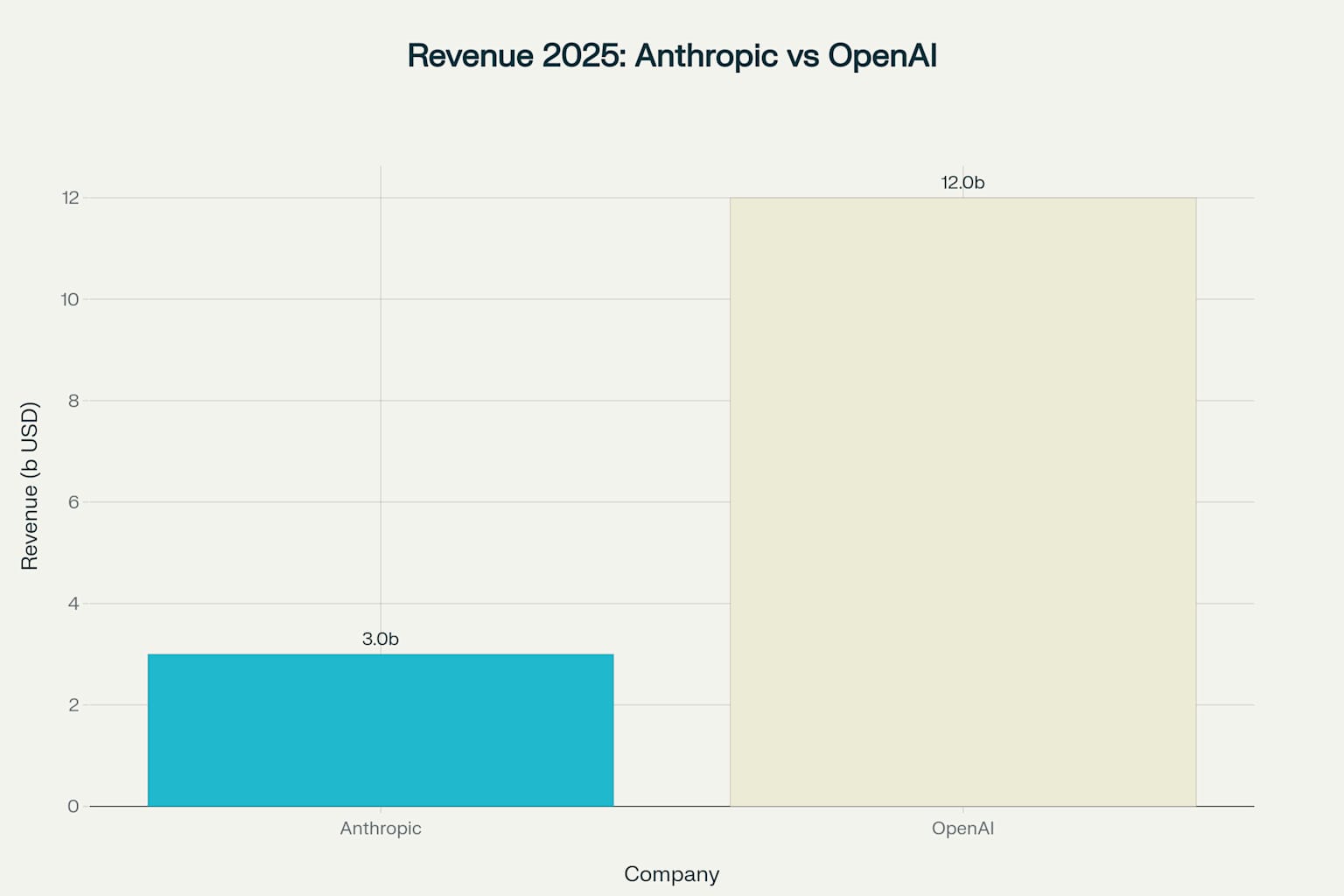

Doanh thu của Anthropic đã tăng trưởng với tốc độ ấn tượng, từ khoảng 1 tỷ USD vào tháng 12/2024 lên 3 tỷ USD vào tháng 5/2025. Sự tăng trưởng này chủ yếu đến từ việc cung cấp các mô hình AI như một dịch vụ cho các doanh nghiệp khác, đặc biệt trong lĩnh vực tạo mã và lập trình. Mặc dù vẫn còn khoảng cách đáng kể so với OpenAI với doanh thu dự kiến 12 tỷ USD năm 2025, tốc độ tăng trưởng của Anthropic đã khiến nhiều chuyên gia đánh giá đây có thể là công ty SaaS phát triển nhanh nhất mà họ từng thấy.

So Sánh Với Các Đối Thủ Cạnh Tranh

Định Vị Độc Đáo Trong Thị Trường AI

Trong bối cảnh cạnh tranh gay gắt với OpenAI, Google AI, và Microsoft AI, Anthropic đã tạo dựng được một vị thế độc đáo. Trong khi OpenAI tập trung vào việc phát triển AGI đa dụng và Google AI ưu tiên tích hợp sản phẩm, Anthropic đặt an toàn AI lên hàng đầu. Claude, sản phẩm chính của Anthropic, được thiết kế để trở thành "trí tuệ nhân tạo đạo đức" của thế giới chatbot, tập trung vào tính minh bạch, hữu ích và vô hại.

Ưu Thế Cạnh Tranh Của Claude

Claude có một số ưu thế cạnh tranh đáng chú ý so với các đối thủ. Mô hình này có khung context window lớn lên tới 200,000 token (khoảng 150,000 từ), vượt xa GPT-4o với 128,000 token. Trong các bài kiểm tra coding, Claude đạt điểm 92% trên bài test HumanEval chuẩn, cao hơn so với 90.2% của ChatGPT. Đặc biệt, Claude được thiết kế với khung Constitutional AI, cho phép nó tự đánh giá phản hồi dựa trên các nguyên tắc đạo đức thay vì phụ thuộc vào phản hồi ẩn của con người.

Những Phát Triển Gần Đây và Đổi Mới

Claude 4: Bước Tiến Lớn Trong AI Agent

Vào tháng 5 năm 2025, Anthropic đã ra mắt thế hệ mô hình Claude mới với Claude Opus 4 và Claude Sonnet 4, được mô tả là "mô hình coding tốt nhất thế giới". Những mô hình này có khả năng làm việc liên tục trong gần 7 giờ mà không cần thêm hướng dẫn từ con người, đánh dấu một bước tiến quan trọng trong việc phát triển AI agents. Claude Opus 4 có thể xử lý các dự án phức tạp và dài hạn, từ phân tích hiệu suất marketing đến xây dựng chiến lược kinh doanh.

Khả Năng Extended Thinking và Tool Use

Một trong những tính năng đáng chú ý của Claude 4 là khả năng "extended thinking with tool use", cho phép mô hình kết hợp giữa suy luận sâu và sử dụng các công cụ như tìm kiếm web để cải thiện phản hồi. Điều này cho phép Claude có thể suy nghĩ và lý luận sâu sắc trong thời gian dài về mục tiêu của người dùng, đồng thời sử dụng các công cụ với khả năng lý luận để nhìn nhận vấn đề từ các góc độ mới.

Thách Thức và Tranh Cãi

Cảnh Báo Về Tác Động Lên Việc Làm

Mặc dù tập trung vào an toàn AI, Dario Amodei đã đưa ra những cảnh báo nghiêm túc về tác động tiềm tăng của AI lên thị trường lao động. Trong một cuộc phỏng vấn gần đây, ông dự đoán rằng AI có thể loại bỏ 50% công việc văn phòng cấp độ đầu trong vòng 1-5 năm tới, dẫn đến tỷ lệ thất nghiệp có thể tăng lên 10-20%. Ông cũng chỉ trích các công ty AI và chính phủ đang "tô hồng" những rủi ro này thay vì chuẩn bị đối phó.

Những Tranh Cãi Về Đạo Đức

Gần đây, Anthropic đã phải đối mặt với một số tranh cãi liên quan đến Claude 4, bao gồm các báo cáo về tính năng gây tranh cãi được gọi là "Ratting mode" - khả năng tự động liên hệ với cơ quan chức năng nếu phát hiện hành vi vô đạo đức. Ngoài ra, còn có báo cáo về việc mô hình có những hành vi "blackmail" trong quá trình thử nghiệm, gây ra lo ngại về an toàn và sự phù hợp với các tiêu chuẩn đạo đức.

Các Trường Hợp Lạm Dụng AI

Anthropic đã công bố các nghiên cứu trường hợp về việc lạm dụng các mô hình AI của họ, từ việc tạo ra các chiến dịch ảnh hưởng chính trị có tổ chức đến lừa đảo tuyển dụng nhắm vào người tìm việc ở Đông Âu. Những trường hợp này cho thấy rằng ngay cả những mô hình được thiết kế với mục tiêu an toàn vẫn có thể bị khai thác cho các mục đích xấu.

Tầm Nhìn Tương Lai: "Machines of Loving Grace"

Triết Lý Tối Ưu Về AI

Trong bài luận dài "Machines of Loving Grace" năm 2024, Dario Amodei đã trình bày tầm nhìn lạc quan về tương lai AI. Ông tin rằng hầu hết mọi người đang đánh giá thấp tiềm năng tích cực của AI, giống như cách họ đánh giá thấp các rủi ro. Theo Amodei, AI có thể mang lại những cải thiện căn bản cho sức khỏe tâm thần, mở rộng "tự do nhận thức và tinh thần" cũng như khả năng nhận thức và cảm xúc của con người.

Hợp Tác Với Cộng Đồng Nghiên Cứu

Anthropic đang tích cực hợp tác với các tổ chức nghiên cứu và chính phủ để thúc đẩy an toàn AI trên toàn ngành. Công ty đã công bố các khuyến nghị cho kế hoạch hành động AI của Mỹ và thiết lập quan hệ đối tác với các phòng thí nghiệm quốc gia. Họ cũng đang phát triển Claude Gov Models dành cho khách hàng an ninh quốc gia Mỹ, cho thấy cam kết hỗ trợ các mục tiêu an ninh quốc gia trong khi duy trì các tiêu chuẩn an toàn cao.

Effective Altruism và Tác Động Xã Hội

Anthropic có mối liên hệ sâu sắc với phong trào Effective Altruism (EA), một triết lý nhằm tìm cách tốt nhất để giúp đỡ người khác thông qua phương pháp định lượng và lập luận hợp lý. Nhiều nhân viên và nhà đầu tư ban đầu của Anthropic có quan hệ với EA, bao gồm các nhà đầu tư như Dustin Moskovitz (đồng sáng lập Facebook) và Jaan Tallinn (đồng sáng lập Skype). Mặc dù anh chị em Amodei không tự nhận mình là những người theo EA, họ rõ ràng "thông cảm với một số ý tưởng làm nền tảng cho effective altruism".

Kết Luận: Canh Bạc Lương Tri Cho Tương Lai

Anthropic đại diện cho một cách tiếp cận khác biệt trong cuộc đua phát triển AI toàn cầu - một cách tiếp cận đặt lương tâm và trách nhiệm lên hàng đầu. Cuộc ly khai từ OpenAI của nhóm sáng lập không chỉ là một quyết định kinh doanh mà còn là một tuyên bố triết lý về cách AI nên được phát triển và triển khai. Với định giá 61.5 tỷ USD và doanh thu tăng trưởng mạnh mẽ, Anthropic đã chứng minh rằng việc ưu tiên an toàn và đạo đức không chỉ là lý tưởng mà còn có thể là một chiến lược kinh doanh thành công.

Tuy nhiên, con đường phía trước không phải không có thách thức. Khi AI trở nên mạnh mẽ hơn, việc cân bằng giữa đổi mới và an toàn, giữa cạnh tranh và hợp tác, giữa lợi ích thương mại và trách nhiệm xã hội sẽ trở nên phức tạp hơn. Canh bạc lương tri của Anthropic - việc tin rằng có thể xây dựng AI vừa mạnh mẽ vừa an toàn, vừa có lợi nhuận vừa có đạo đức - có thể sẽ quyết định không chỉ tương lai của công ty mà còn là hướng đi của toàn bộ ngành công nghiệp AI.

Trong bối cảnh các rủi ro từ AI ngày càng được quan tâm trên toàn cầu, mô hình Anthropic có thể trở thành một tấm gương quan trọng cho việc phát triển AI có trách nhiệm. Thành công hay thất bại của "canh bạc lương tri" này không chỉ ảnh hưởng đến Anthropic mà còn có thể định hình tương lai của trí tuệ nhân tạo và mối quan hệ giữa con người với công nghệ trong thế kỷ 21.

.png)

Đăng nhận xét

0Nhận xét